复合型机器人 Caster+机械臂

全向移动底盘搭载多传感器融合系统,实现室内高精度定位与自主导航,机械臂抓取,适用于科研教育、室内搬运等多场景应用。

基础入门版户外四驱底盘

全地形适应,GPS+北斗双模定位

双臂协作平台

6自由度机械臂,视觉引导精准抓取

让自主移动机器人服务于人类

全向移动底盘搭载多传感器融合系统,实现室内高精度定位与自主导航,机械臂抓取,适用于科研教育、室内搬运等多场景应用。

全地形适应,GPS+北斗双模定位

6自由度机械臂,视觉引导精准抓取

精准定位不丢失,多维度融合

厘米级SLAM建图路径规划

360°环境感知与动态路径规划

融入深度强化学习的实时决策系统,无需人工干预即可完成复杂任务规划与执行。

毫米级SLAM建图与定位,点云粒子重匹配。

激光雷达相机多维感知,强化学习,神经网络融合避障。

以AI促产教融合

将YOLO用于机器人

强化学习用于机器人自适应避障

将图像分割的水坑检测用于机器人

共享地图、目标、定位、感知

视觉-语言-导航,在预定义下的3D环境中通过视觉感知语言指令通过扩散策略到达目标。典型的框架有VNt,Nomad。

视觉-语言-动作,模型直接接收多摄像头视频流、激光雷达点云等传感器数据以及可能的高层语言指令通过一个端到端的神经网络,输出连续的 动作控制信号。如Π0,SmolVLA,openVLA。

视觉-其他-动作,模型直接接收多摄像头视频流、激光雷达点云等传感器数据通过一个端到端的神经网络,输出连续的 动作控制信号。

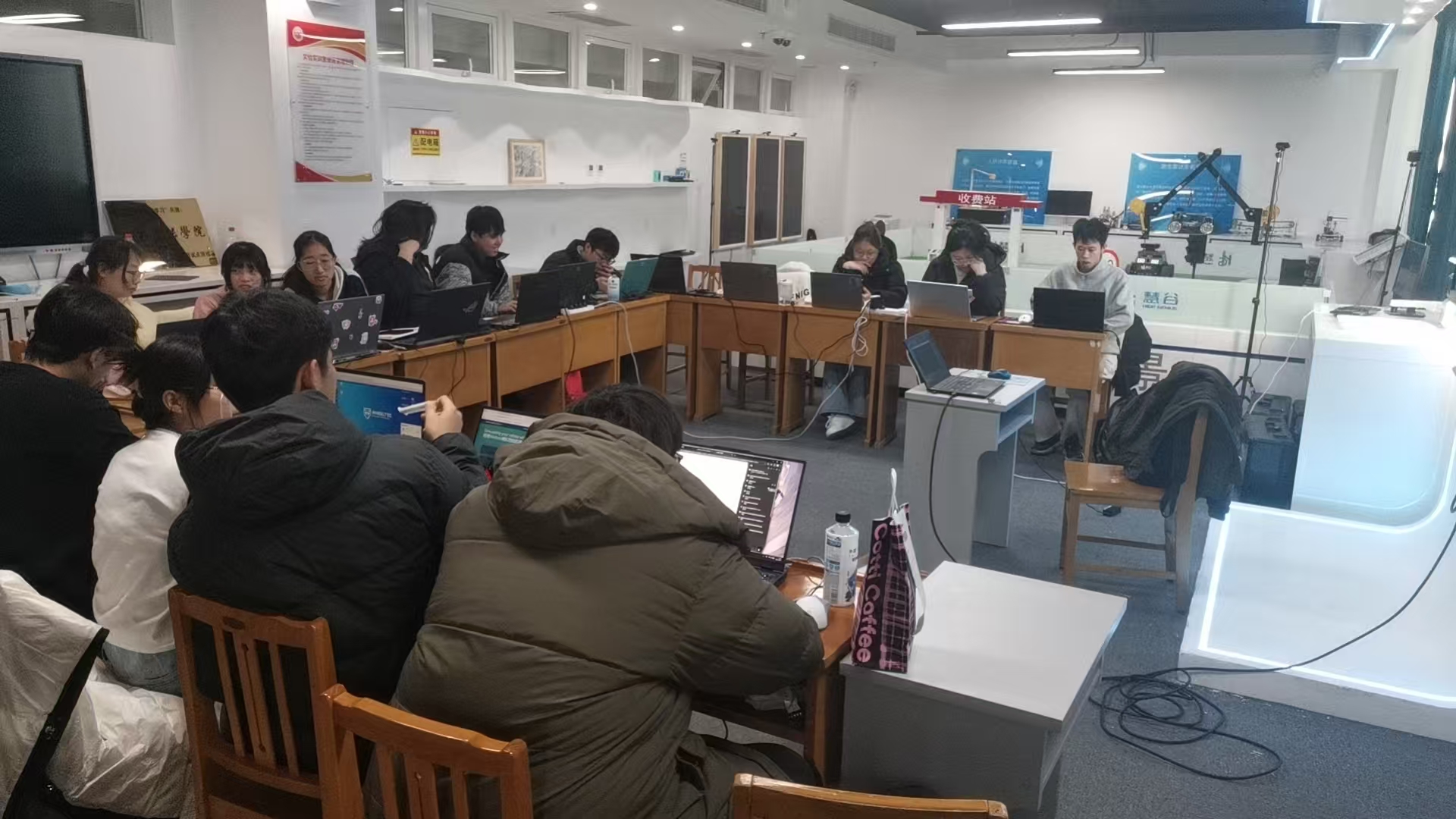

打造一流的机器人科研实践平台,助力高校与研究机构建设智能实验室

与我们的专家团队联系,获取定制化解决方案

关注公众号与B站,获取AI机器人最新。

视觉动力机器人官方公众号

添加微信,备注:合作/咨询